边缘 GPU 太贵?用 Time-Slicing 把一台 Orin “切”成 4 台跑并发容器

2026-04-01 09:25:00

#GPU虚拟化 #TimeSlicing #边缘AI #NVIDIA #JetsonOrin #Do

一、 场景痛点:被“贪婪的显存”逼疯的成本模型

上周,我们审查了一个 3C 电子厂的“四工位视觉防错”项目,集成商(SI)的硬件架构设计堪称灾难:

业务需求:一条流水线上有 4 个工位,每个工位 1 个相机。需要同时运行 4 个独立的缺陷检测容器(基于 YOLOv11 + TensorRT)。

现状:集成商采购了一台价值 ¥6,500 的 NVIDIA Jetson AGX Orin (32GB)。

事故现场:

启动工位 1 的 Docker 容器,一切正常。

启动工位 2 的容器时,终端直接飙红报错:CUDA Error: out of memory (OOM)。

查看 jtop,发现工位 1 的模型实际上只用了 20% 的算力,但它像流氓一样霸占了几乎所有的可用显存(VRAM)。

无效的妥协:为了交差,集成商被迫向甲方追加预算,买了 4 台低配的 Orin Nano(每台跑一个工位),BOM 成本直接翻倍,电控柜被塞得满满当当。

架构师指令:严禁在边缘端进行“1 个容器独占 1 个物理 GPU”的奢侈部署。

在数据中心,我们用 MIG(多实例 GPU)切分 A100。但在边缘端芯片(如 Orin / RTX 4060)上不支持 MIG,我们必须引入 NVIDIA Time-Slicing(时间分片虚拟化) 机制,配合环境变量,实现单 GPU 的安全多路复用。

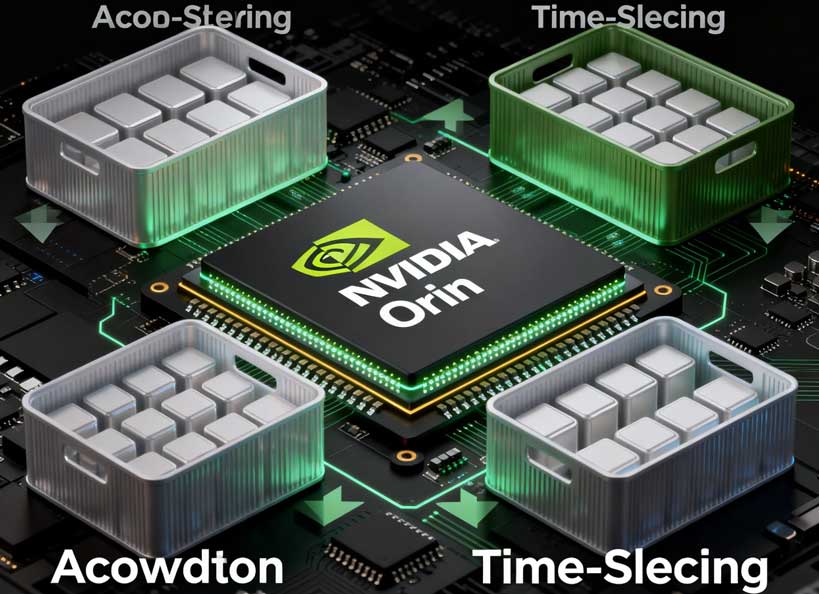

二、 架构设计:Time-Slicing (时间分片) 机制

由于边缘计算显卡不支持物理级的硬件隔离,我们采用底层的**上下文切换(Context Switching)**技术:

骗过容器:通过修改 NVIDIA Container Toolkit,告诉 Docker 引擎:“我这台机器上不是有 1 块物理 GPU,而是有 4 块虚拟 GPU”。

分时复用:当 4 个容器同时发起 CUDA 计算请求时,GPU 底层的调度器会像 CPU 切分时间片一样,以微秒级的高频在 4 个任务间来回切换。

显存锁死:配合深度学习框架的参数,强制限制每个容器的显存上限,防止“一个人吃光,全家饿死”。

4x 工业相机 ->[ 4x 独立 Docker 容器 (各以为自己独占 GPU) ] --(Time-Slicing 调度)--> [ 1块物理 GPU ]

三、 核心实施步骤 (Copy & Paste)

假设你正在使用运行 JetPack 6/7 或 Ubuntu 24.04 的边缘计算主机,且已安装 nvidia-container-toolkit。

1. 开启全局 Time-Slicing 配置

在宿主机上,配置 NVIDIA 设备插件以开启虚拟化。

编辑 /etc/docker/daemon.json(或 CDI 配置文件),我们要把 1 块 GPU 虚拟成 4 块。

{

"default-runtime": "nvidia",

"runtimes": {

"nvidia": {

"path": "nvidia-container-runtime",

"runtimeArgs":[]

}

},

"node-status-update-frequency": "10s",

"device-plugin": {

"config": {

"name": "Orin-Time-Slicing",

"version": "v1",

"flags": {

"migStrategy": "none"

},

"sharing": {

"timeSlicing": {

"resources":[

{

"name": "nvidia.com/gpu",

"replicas": 4 // 核心魔法:1 变 4

}

]

}

}

}

}

}2. 编写 Docker-Compose 编排文件

现在,你可以像拥有 4 块显卡一样,把它们分配给 4 个独立的容器。

version: '3.8' x-gpu-template: &gpu-template deploy: resources: reservations: devices: - driver: nvidia count: 1 # 虽然写的是 1,但它拿到的是 1/4 的时间片 capabilities: [gpu] environment: # 极度关键:开启 CUDA 懒加载,极大降低初始化显存占用 (节省 300MB+) - CUDA_MODULE_LOADING=LAZY # 限制 PyTorch 的显存分配器,防止其预占所有显存 - PYTORCH_CUDA_ALLOC_CONF=max_split_size_mb:128 services: station_1_yolo: image: my-vision-app:v1.0 container_name: station_1 <<: *gpu-template station_2_ocr: image: my-vision-app:v1.0 container_name: station_2 <<: *gpu-template station_3_llm: image: my-edge-vlm:v1.0 container_name: station_3 <<: *gpu-template station_4_tracking: image: my-vision-app:v1.0 container_name: station_4 <<: *gpu-template

3. 业务代码层的防 OOM 改造 (Python 示例)

在你的推理脚本中,绝对禁止框架按默认策略吃光显存。必须在初始化时硬性限制显存增长。

import tensorflow as tf

# 或者对于 TensorRT, PyTorch 同理,需限制 Workspace Size

gpus = tf.config.experimental.list_physical_devices('GPU')

if gpus:

try:

# 禁止一开始就占满显存,按需动态申请

for gpu in gpus:

tf.config.experimental.set_memory_growth(gpu, True)

# 甚至可以直接硬性限制该进程最多只能用 4096 MB (4GB) 显存

tf.config.experimental.set_virtual_device_configuration(

gpus[0],

[tf.config.experimental.VirtualDeviceConfiguration(memory_limit=4096)])

except RuntimeError as e:

print(e)四、 踩坑复盘 (Red Flags)

1. “上下文切换 (Context Switching)”的性能损耗

现象:切成 4 块后,总算力并没有达到 100%,而是感觉只有 85%,且每个相机的推理延迟从 15ms 增加到了 25ms。

原因:GPU 在不同容器的任务之间来回切换状态,是需要消耗时间的(通常在百微秒级别)。

对策:如果你的产线节拍极度苛刻(如飞拍要求 10ms 以内返回结果),不要使用 Time-Slicing。此时建议将 4 路相机的码流汇聚到一个 C++ 进程中,用 Batch Inference(批处理推理,Batch Size = 4) 的方式送入 TensorRT,这才是最高效的物理利用方式。

2. 故障隔离的不彻底

风险:Time-Slicing 是软件级隔离,不是硬件隔离。如果“工位 3”的算法写出了死循环或者触发了底层的 CUDA Kernel Panic,整块物理 GPU 都会挂掉,导致另外 3 个工位一起陪葬。

避雷:在同一个物理机上切分出来的容器,其安全等级必须是一致的。不要把核心的“急停视觉判定”和外围的“大屏统计报表”切分在同一块卡上。

3. TensorRT Workspace 冲突

现象:多个容器同时加载基于 TensorRT 的 .engine 文件时崩溃。

对策:在导出 TensorRT 引擎时,必须显式调低 --workspace 参数(例如从默认的 4GB 降到 1GB)。在边缘端,工作空间(Workspace)也是大家抢夺的珍贵显存资源。

五、 关联资源与选型

要玩转 GPU 切片和多容器并发,大内存和高带宽是硬指标。

硬件推荐:

研华 MIC-733 (NVIDIA AGX Orin 64GB):做多路虚拟化的究极神器。64GB 的大显存让你切分出 8 个虚拟 GPU 都毫不费力。

基于 Intel Core Ultra (带独立 NPU) 的工控机:如果你的任务都是轻量级 AI,利用 Intel 的 OpenVINO 异构调度,可以让 CPU 跑两路、GPU 跑两路、NPU 跑两路,天然实现物理隔离,免去了 Time-Slicing 的配置地狱。

一键克隆底座

环境配置总出错?

我们准备了一个 "Edge GPU Virtualization 基础底座"。

包含:预配置 Time-Slicing 的 daemon.json、解决显存泄漏的 Docker-Compose 模板、以及基于 Prometheus 的容器级 GPU 监控大屏。

架构师福利:下载“一卡多用” GPU 虚拟化边缘容器套件