原子能力

Llama.cpp

厂商/来源:

Georgi Gerganov

核心功能:

“把 GPT 装进 CPU”。目前全球最火的让普通电脑和边缘设备跑大语言模型(LLM)的底层框架。

| 适用场景 | 离线断网的工业知识问答、边缘侧敏感数据清洗(隐私保护)、机器指令自然语言解析 |

| 架构支持 | CPU (AVX2/NEON 优化极佳,纯 CPU 也能跑) Apple Silicon (M1/M2/M3 性能逆天) NPU (逐步支持 RK3588/高通) |

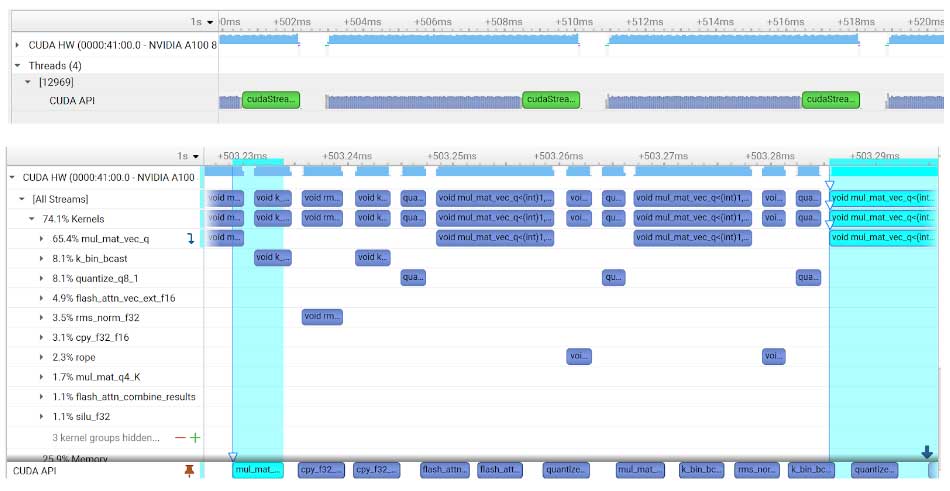

| 核心机制 | GGUF 量化:这是核心黑科技。它能将几百 GB 的模型参数压缩成 Int4 (4-bit) 甚至 Q2_K (2-bit)。在精度损失极小的情况下,将内存需求降低 70% 异构计算:支持将模型的一半层级放在 CPU 跑,另一半放在 GPU 跑 (Offload),充分利用边缘设备有限的资源。 |

| 性能指标 | RK3588 (16G):运行 Qwen1.5-7B-Chat-Int4 模型,推理速度可达 3-5 tokens/s (勉强可对话) Mac Mini (M2):速度可达 30+ tokens/s (飞快)。 |

| 避坑指南 | [内存带宽瓶颈] 1. 内存为王:在边缘侧,推理速度不取决于 CPU 频率,而取决于 内存带宽。双通道内存比单通道快一倍。选型建议:买工控机时,务必插满双根内存条。 2. 中文支持:Llama.cpp 原生对中文分词支持曾有问题,虽然现在改善了,但仍建议使用专门针对中文优化的模型权重 (如 Qwen, Yi, DeepSeek),不要硬跑 Llama3 原版(中文能力弱)。 |

| 推荐搭配 | [大内存工控机 (32G+)] [Qwen (通义千问) GGUF 模型] |