内存暴涨 105% 逼疯工控机;NXP/TI 齐发大招:暴砍 60 个射频 BOM 器件,MCU 标配 NPU

2026-03-13 11:16:00

#EmbeddedWorld2026 #DRAM涨价 #虚拟化 #NXP #i.MX93W #TI

01. 供应链海啸:AI 算力虹吸导致 DRAM 暴涨 105%,工业计算被迫走向“单机虚拟化”

【动态速递】据本周最新供应链报价,受全球 AI 服务器需求对 HBM 和 DDR5 产能的严重“虹吸”影响,标准 DRAM 内存颗粒价格在过去一年内累计暴涨超过 105%。

成本恶化:对于系统集成商而言,一台标配 16GB 或 32GB 内存的 x86 视觉工控机,其内存成本占整机 BOM 的比例已从 16% 畸升至 23%,直接击穿了很多项目的利润生死线。

厂商对策:在纽伦堡 Embedded World 2026 展会上,威强电 (iEi) 等一线工控厂商重点展出了 “iVEC 虚拟化边缘计算机”。其核心理念是:不再为 SCADA、机器视觉、软 PLC 分别购买三台独立的低配物理机,而是购买一台大内存的高性能物理机,利用底层 Hypervisor(虚拟化技术)将其拆分为多个互不干扰的虚拟机。

【云质变视点】

“硬件堆叠的时代结束了,用‘算力切片’来对抗内存通胀。

内存太贵,买三台机器装三根内存条成了亏本买卖。通过虚拟化(如 Proxmox VE 或 ACRN),一台机器跑多套系统,不仅能把闲置的 CPU 性能榨干,还能省下两个机箱、两套电源和主板的钱,以此来抵消内存的涨价。

采购总监不要再盯着内存单价去砍价了,大势不可逆。请立刻要求研发团队掌握工业虚拟化部署能力,通过修改系统架构来降低单点位的 TCO(总拥有成本)。

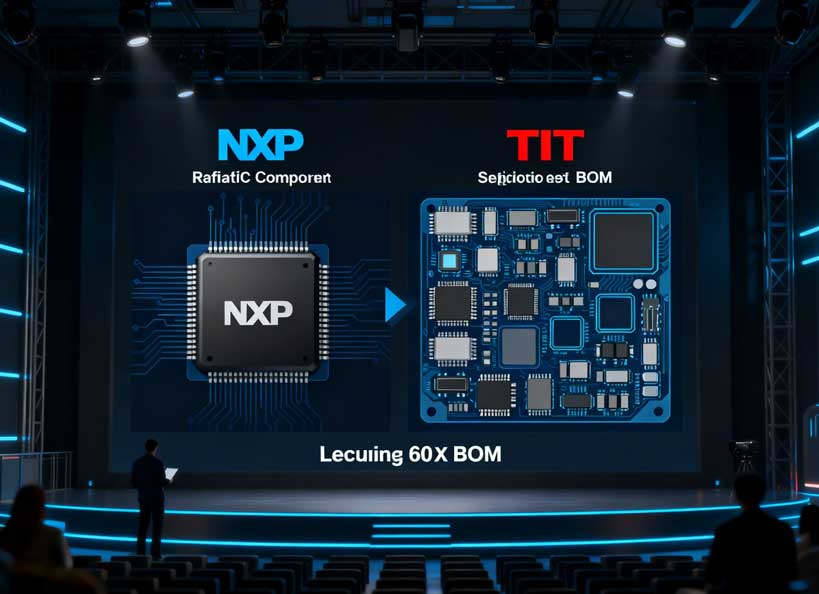

02. 集成革命:NXP 发布 i.MX 93W,单芯片消灭 60 个外围无线元器件

【动态速递】恩智浦 (NXP) 在展会上重磅发布了针对边缘物联网的 i.MX 93W 集成无线应用处理器。

极致缝合:这颗芯片将 Cortex-A55 主核、Ethos U-65 NPU、EdgeLock 安全岛,以及 IW610G 三模无线电(双频 Wi-Fi 6 + 蓝牙 + 802.15.4/Matter) 全部封装在了一起。

降维打击:不仅是把芯片合二为一,NXP 还将无源器件、晶振和射频 (RF) 前端全部预集成。

价值:这一“全家桶”设计,直接帮硬件工程师在 PCB 图纸上删掉了多达 60 个 BOM 元器件。

【云质变视点】

“中小网关厂家的‘射频工程师’可能要失业了。

以前自己画一块带 Wi-Fi 和 Zigbee 的网关板子,最痛苦的就是射频天线的阻抗匹配和过各种无线电认证(FCC/CE),稍有不慎就信号极差。

NXP 这个方案是预先验证过的。你买回来画好电源线就能用,直接省去了几个月的 RF 调优时间和几万块的认证测试费。

03. 算力下沉:TI 为 80MHz 的 MCU 塞入 NPU,“物理 AI”进入微处理器时代

【动态速递】德州仪器 (TI) 在本次展会上颠覆了业界对“AI 芯片”的认知,发布了新型 MCU(微控制器)系列 MSPM0G5187 和 AM13Ex。

反直觉配置:在仅仅 80MHz / 200MHz 的 Cortex-M0+ 或 M33 超低功耗内核旁,TI 强行塞入了一个名为 TinyEngine 的神经处理单元 (NPU),算力达到 2.56 GOPS。

应用场景:它不是用来跑大语言模型或视频识别的,而是专门用于电机实时控制中的边缘 AI(如:通过电机电流的微小波形变化,利用 AI 直接判断轴承是否即将损坏,或者进行极其复杂的 AI 麦克风阵列降噪)。

【云质变视点】

“AI 不再是 Linux 盒子的专属特权,几块钱的单片机也长出了‘脑子’。

以前做电机的预测性维护,必须把高频电流数据传给网关,让网关里的 CPU 去算 FFT 和 AI 模型。

现在,智能传感器和伺服驱动器本身就能直接跑 AI 推理,输出的不再是原始数据,而是直接告诉你:‘我 3 天后要坏了’。

研发总监们,请立刻让你的单片机(C语言)工程师开始接触 TinyML 生态。未来的工业末端执行器,如果不带本地 AI 诊断功能,将失去进军高端市场的资格。